이 글의 원문은 https://opencv-python-tutroals.readthedocs.io/en/latest/py_tutorials/py_feature2d/py_brief/py_brief.html 입니다.

지금까지 살펴본 SIFT나 SURF 등은 이미지의 특징점을 검출하기 위해 제법 많은 메모리를 사용하는데, 자원에 제약이 심한 임베디드 장비에서는 메모리를 적게 사용하는 특징점 검출 방법이 필요하며, 그 방법이 바로 BRIEF입니다.

BRIEF는 특징점에 대한 기술자(Descriptor)일 뿐, 특징점을 검출하는 방법은 제공하지 않는데.. 이를 위해 다른 특징점을 검출하는 SIFT나 SURF 등을 사용해야 합니다. BRIEF에 대해 설명하는 논문에서는 CenSurE를 추천하고 있습니다. OpenCV에서는 이를 STAR라고도 합니다. 여튼 CenSurE는 빠르며 다른 방법보다 BRIEF에 더 최적화되어 있다고 합니다.

OpenCV에서 제공하는 BRIEF의 예제를 살펴보면 다음과 같습니다.

import numpy as np

import cv2

from matplotlib import pyplot as plt

filename = './data/butterfly.jpg'

img = cv2.imread(filename, 0)

star = cv2.xfeatures2d.StarDetector_create()

brief = cv2.xfeatures2d.BriefDescriptorExtractor_create()

kp = star.detect(img,None)

kp, des = brief.compute(img, kp)

img2 = cv2.drawKeypoints(img, kp, None, (255,0,0))

cv2.imshow('img2', img2)

cv2.waitKey(0)

cv2.destroyAllWindows()

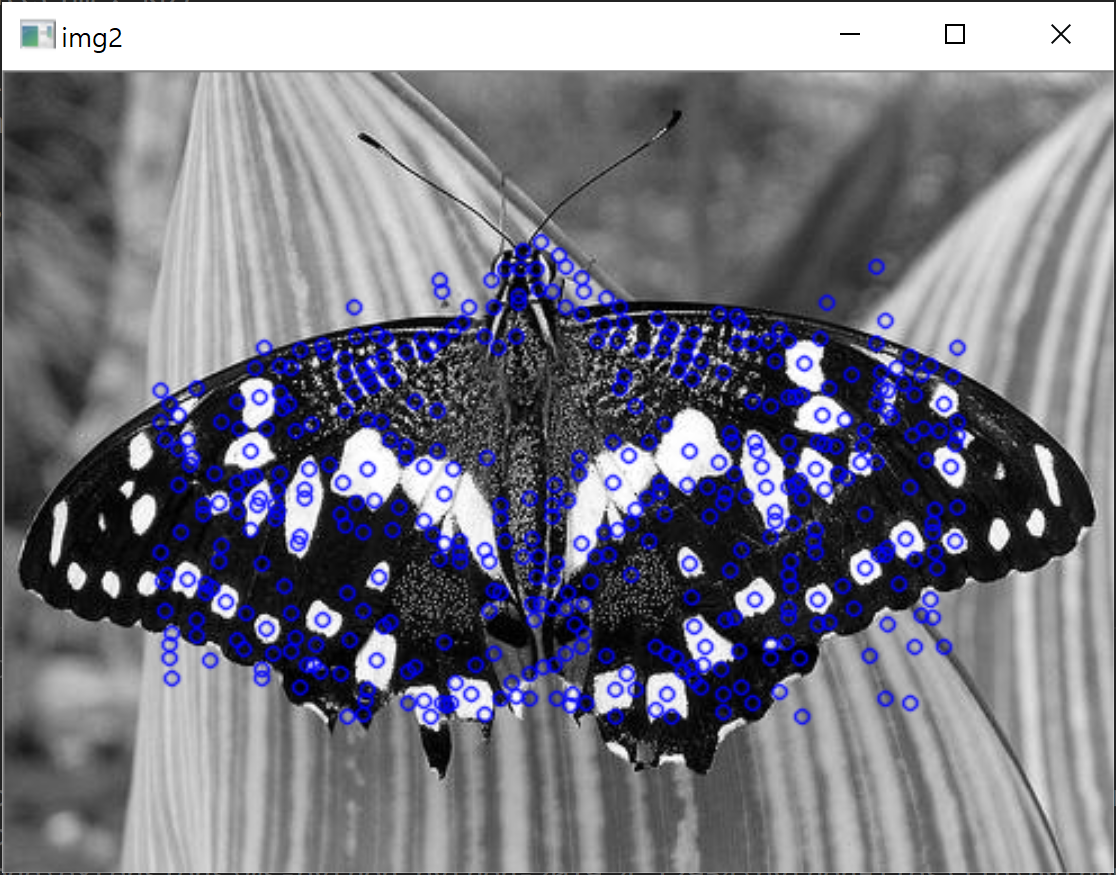

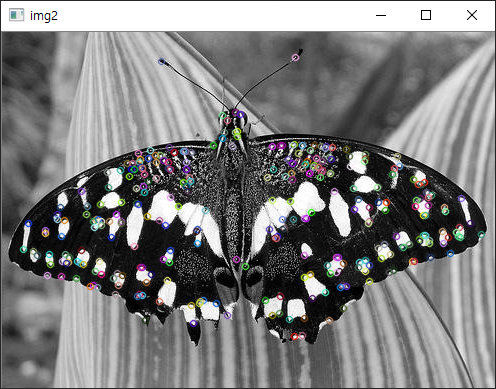

8번은 STAR 특징점 검출을 위한 객체를 생성합니다. 이렇게 생성된 STAR 검출기를 통해 특징점을 검출하고, 이 특징점을 이용해 9번 코드에서 생성한 BRIEF 객체를 통해 특징점의 기술자(Descriptor)를 계산하는 것입니다. 실행 결과는 다음과 같습니다.